Etude

Entreprises : vers une croissance sans risques à l’ère de l’IA

Article co-écrit avec Richard Eudes, Directeur Risk Advisory et Paul-Marie Carfantan, Consultant Risk Advisory

À mesure que l’adoption de l’Intelligence Artificielle (IA) se généralise, comment les entreprises parviennent-elles à gérer les risques associés et garder une longueur d’avance ? Alors que les solutions d'IA prolifèrent – des offres personnalisées aux applications d'entreprise, en passant par les technologies embarquées – l'étude Deloitte AI 2020 révèle une prise de conscience croissante des risques associés à l’IA ainsi qu’une plus grande diversité dans les solutions mises en œuvre par les entreprises pour y remédier.

Ces dernières années, de plus en plus d'entreprises ont expérimenté la data science, amélioré leurs capacités liées aux données, acquis de nouvelles technologies et de nouveaux talents pour intégrer l'IA dans leurs processus métiers. Indiscutablement, l'IA va devenir la norme, et peut-être plus tôt que prévu. Par conséquent, les entreprises ayant déjà largement investi sur l'IA devraient continuer à se différencier. Celles n’ayant pas encore adopté ces technologies pourraient accélérer leurs efforts sur leurs technologies, processus et talents.

L’étude Deloitte 2020 « State of AI in the Enterprise » dévoile les enseignements suivants :

- Les « IA Adoptants » (entreprises ayant un peu d'applications d'IA déployées) confirment avoir confiance dans la capacité des technologies d’IA à générer de la valeur et un avantage concurrentiel. Si l’on distingue des niveaux de maturité différents, en termes de déploiement comme d’investissement financier, les Adoptants perçoivent globalement l’IA comme un réel avantage concurrentiel et anticipent des transformations basées sur l'IA au sein de leurs organisations et de leurs industries.

- L'avantage des « IA précoces » (entreprises ayant un large nombre d’applications d’IA déployées) pourrait bientôt disparaître. Alors que l’adoption se généralise, les organisations ayant adopté l'IA avant les autres devront accentuer leurs efforts pour conserver leur avance. La plupart des adoptants s'attendent à ce que l'IA soit bientôt intégrée dans des applications communes.

- Presque tous les « adoptants » utilisent l'IA pour améliorer leur efficacité opérationnelle ; les adoptants matures exploitent également ces technologies pour se différencier. Si l'IA est très avantageuse en termes d'automatisation et d'optimisation des processus, les grandes entreprises s'efforcent d'aller au-delà de ces objectifs et utilisent également l'IA pour créer de nouveaux produits et modes de travail.

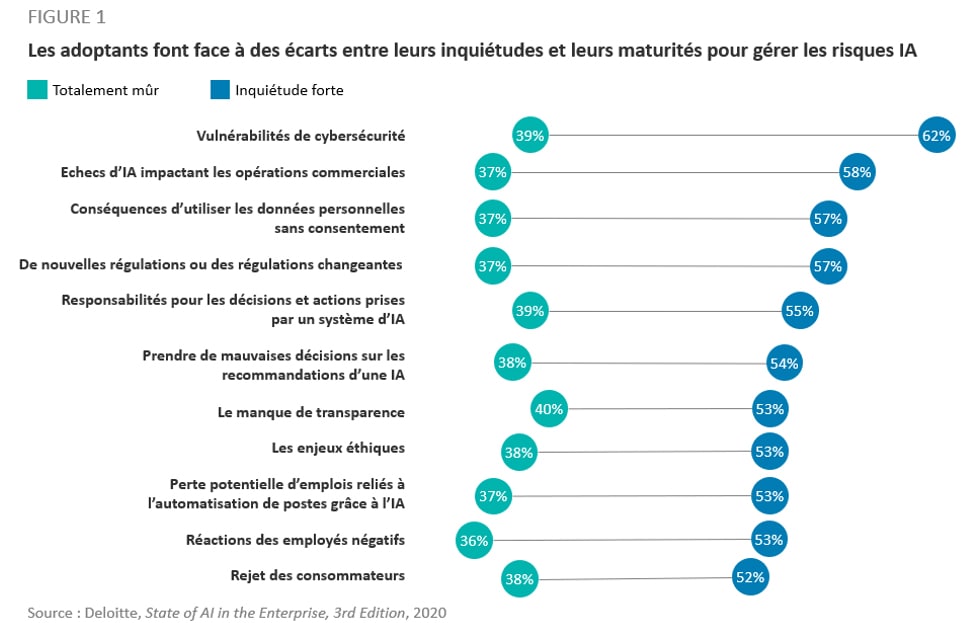

- Enfin, si les adoptants reconnaissent les risques liés l'IA, un certain déficit de préparation laisse émerger de nouveaux risques stratégiques, opérationnels et éthiques. A mesure que l’IA se développe, la prise de conscience des risques qu’elle génère – du biais involontaire à la détermination de la responsabilité – augmente. L'adoption de mesures spécifiques pour remédier à ces risques est encore balbutiante, même pour les adoptants les plus matures. Elle devrait cependant s’accélérer dans les années à venir en Europe compte tenu des annonces de la Commission Européenne.

56%, c’est le pourcentage de répondants qui estiment que leurs projets d’IA sont limités et ralentis en raison de risques émergents, d’une méconnaissance de ces risques ainsi que des solutions possibles.

Ces craintes sont renforcées par l’arrivée attendue de règlementations sur l’utilisation de l’AI. Ainsi, 57% des répondants indiquent être « extrêmement » ou « très largement » inquiets des règlementations à venir (ex : Union Européenne, Directive sur la prise de décision automatique au Canada, adoption de la reconnaissance faciale…) et des impacts sur leurs projets et business.

Même les plus aguerris peuvent encore largement s’améliorer, comme l’illustre le graphique ci-dessus. Les entreprises devront donc mettre en œuvre des processus de gestion des risques IA afin de renouer avec la confiance, adresser les peurs, gagner du temps et de l’agilité.

Pour ce faire, il importe de :

- Répertorier et identifier les projets. Il faut à minima disposer d’une vision claire des projets utilisant de toutes les solutions d’IA au sein de l’organisation. S’il est parfois difficile d’y voir clair, entre shadow IT et décentralisation des initiatives, il est impératif de bien identifier et de lister ces initiatives (incluant le recours à des services tiers / API), pour les intégrer dans la démarche de risk management.

- Aligner l’organisation. Un processus de formation et de gestion des responsabilités autour de la gestion des risques algorithmiques et de l’éthique doit être mis en œuvre. Il peut s’appuyer sur les processus de risk management existants ou s’initier via une organisation spécifique, centralisée, fédérée ou décentralisée selon les besoins de l’entreprise.

- Etablir des procédures pour l’audit et la vérification des algorithmes. Ces procédures sont essentielles pour s’assurer que l’ensemble des enjeux et politiques de l’entreprise soient considérés (dimension éthique, par exemple), que la conformité soit prise en compte (ex : GDPR…) et que le contrôle des biais sur les données et les algorithmes soient mis en œuvre. Enfin, ces procédures doivent adresser le Model Management, à travers les mécanismes de réentrainement des modèles, de contrôle des données en entrée (« drift ») et de l’évolution temporelle des résultats des modèles.

- Caractériser les risques éthiques. Si ces risques sont de nature variée (sécurité physique, discrimination, manque d’explicabilité ou de transparence, …), il est essentiel que l’entreprise soit en capacité de les caractériser par niveau de risque, en fonction ce qui est acceptable ou pas pour l’organisation et la société. Parmi les répondants, 36% affirment établir des règles et politiques relatives l’éthique de l’IA et porter le sujet au niveau du comité exécutif.

Pour permettre un déploiement à l’échelle de l’IA, les entreprises doivent s’assurer de choisir les cas d’usage les plus adaptés et générateurs de valeur, mais également s’assurer qu’un cadre de gouvernance et de pilotage clair soit mis en œuvre, afin de répondre aux enjeux de gestion des risques, de contrôle de la performance et d’éthique dans l’utilisation de ces nouvelles technologies. Ce n’est qu’avec une mise en œuvre efficiente de l’ensemble de ces éléments que les entreprises pourront tirer un avantage compétitif durable de l’utilisation de l’IA.