AIガバナンスの背景 ブックマークが追加されました

AIのリスク対策=AIガバナンス実施の必要性

様々な業界でAI(人工知能)の活用が進んでいます。AIは社会の新たなインフラとしてとらえられており、今後も進化を続け、我々の生活を支え、より便利なものへと変えていくことが期待されています。

一方で、AIによる事故や倫理的問題が顕在化しています。自動運転AIの運転ミスや採用AIの差別的判断、プライバシー侵害など、AIの活用に伴うリスクは多岐に渡り、実際にこれら事故や倫理的問題によりサービスの停止に追い込まれたケースも珍しくありません。これらAIのリスクへの対策として、各国政府を中心としたAI原則の策定や規制の制定などのルール形成の動きが活発化しています。このような状況のもと、企業は自社に関連するAIのリスクをしっかりと認識し、その対策、すなわち「AIガバナンス」の必要性がますます高まっています。

AIガバナンス実施の必要性の高まり

※クリックまたはタップして拡大表示できます

AIの活用における課題の把握

AIのリスク対策を具体的に検討するにあたり、まずはAIの活用における課題を把握する必要があります。ここでは以下3つの観点で、AIの活用における課題を見てみましょう。

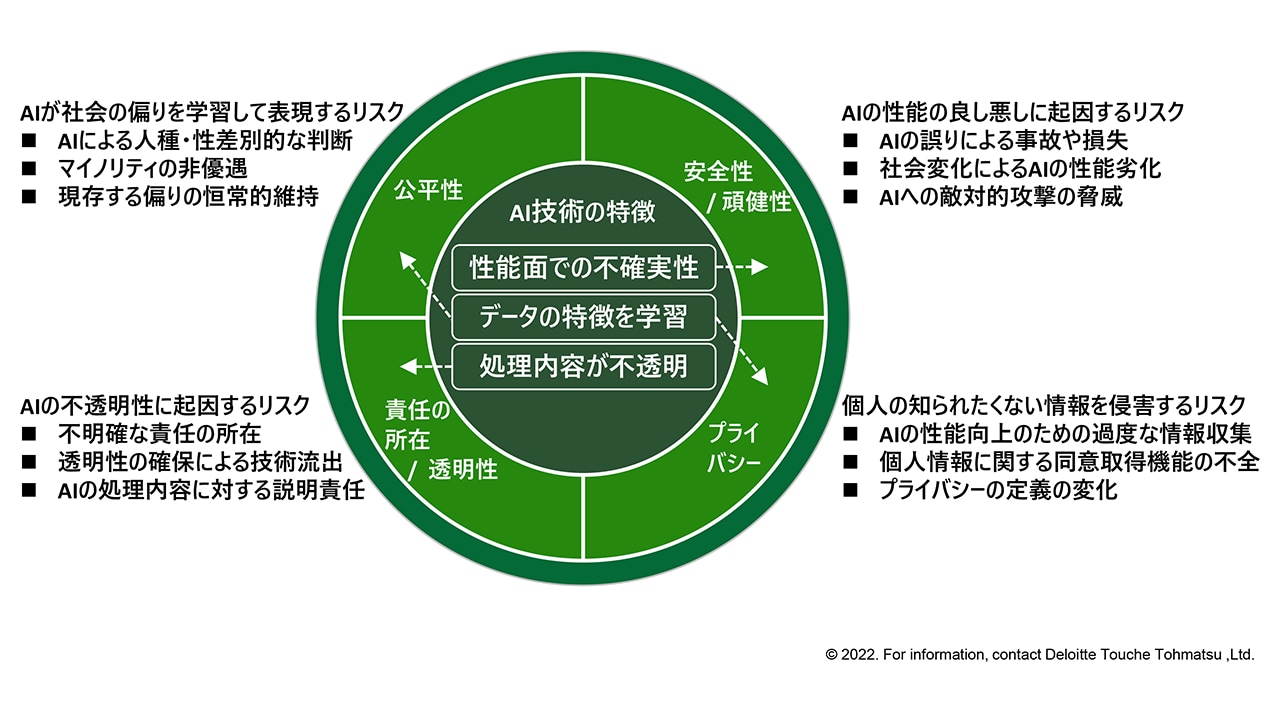

①技術観点の課題

AIは他のテクノロジーと異なる特徴があり、これに起因する様々なリスクが知られています。例えば、AIが既存データの特徴を学習する技術であるがゆえに、既存社会に内在する差別を学習して表現してしまう公平性のリスク、サービスの品質向上を重視するあまり過度にデータを収集し個人のプライバシーを侵害してしまうリスクなどがあります。さらに、性能面での不確実性や処理内容の不透明性などから、安全性や透明性等のリスクも広く認知されています。

AI技術の特徴に起因するリスク

※クリックまたはタップして拡大表示できます

②プロジェクト観点の課題

AIプロジェクトは従来のITプロジェクトと比べ、ガバナンス方針、主幹となる部門、リスクの影響範囲、運用管理の点で異なる特徴があり、従来とは異なるアプローチを検討する必要があります。

AIプロジェクトとITプロジェクトの違い

※クリックまたはタップして拡大表示できます

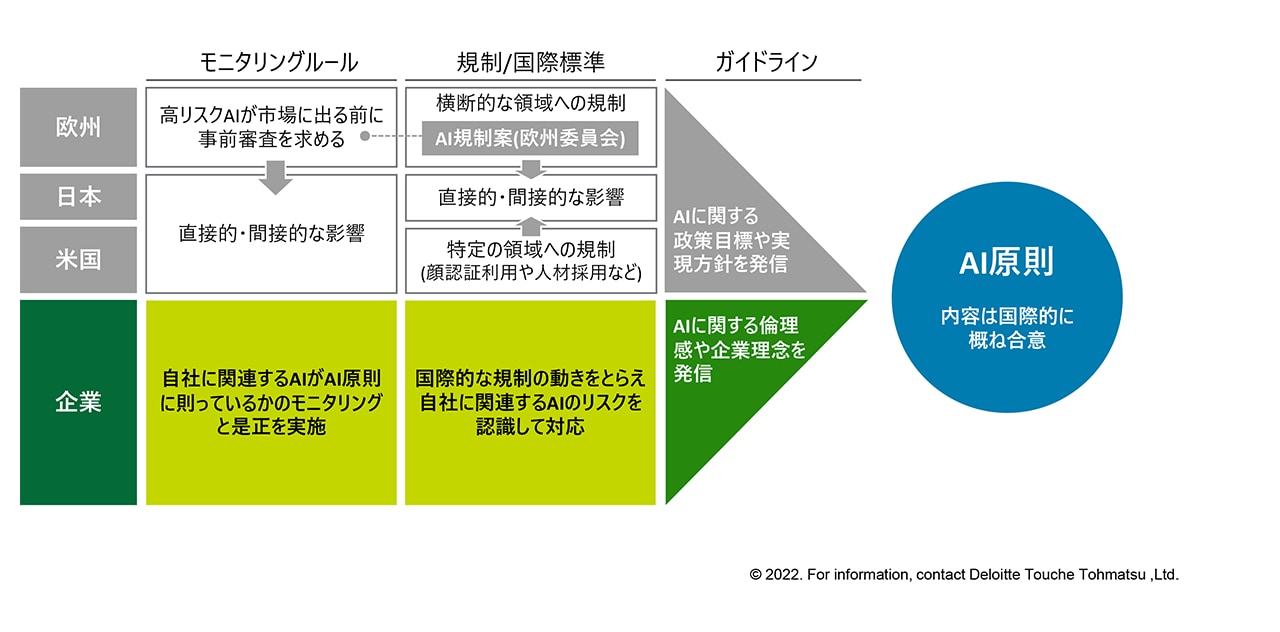

③ルール形成観点の課題

AIのリスクは多岐に及ぶため、個別・具体的な規制のみでその対策を行うことは困難であると世界的に認識されています。そのため各国政府をはじめ、AIに関連する団体は、AIについて目指すべき基本的な考え方をAI原則として定め、その実践方法をガイドライン等の形式で発行しており、その達成にむけたアプローチは各企業に委ねられている状況です。このような現況に加え、技術の進展が速すぎて政策検討が追い付かない、過度な規制を敷くとイノベーションの阻害につながる、第三者による評価が困難である、といった課題が認識されています。

AI原則の達成に向けたルールの全体像

※クリックまたはタップして拡大表示できます

効果的なAIガバナンスを実施するために

AIガバナンスは、これらAIの活用における課題の解決を目指し実施されます。その効果を高めるためには、AIガバナンスに関連する外部組織・システムとの連携も必要です。

外部組織・システムとの連携

※クリックまたはタップして拡大表示できます

AIガバナンスの実施は、AIの活用を促進するだけでなく、ビジネスの迅速な意思決定を可能とし、競争力のある企業文化を醸成します。

デロイトでは、企業が効果的なAIガバナンスを実施するためのTrustworthy AIフレームワークの開発をはじめ、デロイトの多様な専門性およびAIの普及に取り組むDeloitte AI Instituteが持つ最新の知見を結集し、AIに関する多様な課題・ニーズに応えるAIガバナンスサービスを提供しています。これからもAIの活用を阻害する課題やその対策を様々なステークホルダーと検討し、発信していきます。

松本 敬史/Takashi Matsumoto

AIおよびメタバースを含むEmerging Tech全般のガバナンスの研究・サービス開発を推進している。 AIガバナンスの領域においては、産官学でのステークホルダーと連携しながらフレームワークの開発・ケース検討・研究発表等の活動を多く実施している。 東京大学未来ビジョン研究センター客員 AIサービスとリスクコーディネーション研究会(東京大学未来ビジョン研究センター)