Insight

Risikostyring af AI modeller

Trustworthy AI - Ansvarlig, gennemsigtig og etisk håndtering af modeller i offentlige institutioner

Brugen af Artificial Intelligence (AI) er i de senere år steget betydeligt, AI åbner muligheder for at effektivisere og øge hastigheden i beslutningstagningen og udførelsen af førhen manuelle opgaver. På den anden side medfører AI modeller også nye risici. Disse risici kan dog mitigeres med det rigtige framework.

Et framework som Trustworthy AI hjælper virksomheder og institutioner med at kortlægge, hvilke modeller der bruges i den pågældende institution, med henblik på at gøre risiciene ved disse modeller transparente og derved gøre det muligt at styre dem. Denne risikostyring finder sted gennem hele 'livscyklussen' af en model fra konceptdesign til implementering og brug af modellen.

De risici, der er forbundet med brugen af modeller, opstår blandt andet, fordi modellerne ofte bruger komplekse algoritmer og derfor kun forstås fuldt ud af en lille del af medarbejderne. Der kan også være fejl eller bias i modellerne. Desuden er brugen af modeller i forbindelse med udførelsen af visse opgaver relativt ny og ikke altid tilstrækkeligt kendt i de pågældende funktioner.

EU's forslag til regulering vedr. AI, bekræfter at opmærksomheden omkring både fordele og ulemper ved AI er stigende. Lovforslaget (EU AI Act) indeholder adskillige regler bl.a. krav til et risikostyringssystem, data, gennemsigtighed og menneskelig involvering i brugen af AI. Deloitte har publiceret en artikel, som understreger vigtigheden af gennemsigtighed i modellerne, evaluering af machine learning og etik i brugen af AI. Udviklingen af et framework, der garanterer ansvarlig brug af AI, spiller en afgørende rolle heri.

Et klart framework hjælper med at forbedre ansvarlig og etisk brug af AI og styrker dermed tilliden til anvendelsen af modeller. Et styringsmæssigt rammeværk sikrer, at beslutninger, der træffes på grundlag af resultaterne af en model, er gennemsigtige for alle. Desuden skal disse beslutninger være i overensstemmelse med de juridiske og etiske rammer og må ikke udvise bias. I denne artikel vil vi diskutere typerne af modelrisici, hvor disse risici kan forekomme i en models livscyklus, og hvordan disse risici kan mindskes.

Forskellige typer af modelrisici

Den største risiko forbundet med brugen af AI er, at der kan træffes forkerte beslutninger i forbindelse med udførelsen af en virksomheds opgaver. Disse forkerte beslutninger kan have en direkte indvirkning både internt og på eksterne kunder, for eksempel en negativ økonomisk indvirkning på virksomheden eller fordomme baseret på personlige karakteristika. Konsekvenserne af dette kan være store, især hvis der heller ikke er nogen klar måde at udfordre beslutninger, der er truffet på baggrund af modelresultater.

Dette kan også medføre store konsekvenser for en virksomheds omdømme, og påvirke kunders eller involveredes tillid til virksomhedens evne til at benytte sig af AI. Hvis dette sker flere gange, er der en chance for, at brug af modeller på trods af alle fordelene kan blive begrænset.

Derudover er der en række andre måder, hvor modelrisici har indflydelse:

- Indvirkningen når modeller er i konflikt med love, regler og bestemmelser (f.eks. overtrædelse af lovgivningen om ikke-forskelsbehandling og privatlivets fred)

- Økonomiske konsekvenser som effekt af forkert beslutningstagning, eller når der skal betales bøder på grund af forkerte beslutninger

- Indvirkningen på driftsprocesser, når hændelser med modeller forårsager forstyrrelser i forretningsprocesser, mens modellerne forsøger at forbedre disse forretningsprocesser

- Indvirkningen på strategiske beslutninger, når den strategiske beslutningstagning er baseret på fejlagtige modelresultater, anvendes af personer, der ikke har den nødvendige viden, eller er baseret på fejlfortolkede resultater

- Indvirkningen på teknologi, når hændelser med modeller har indflydelse på eksempelvis it-infrastrukturens sikkerhed og stabilitet

Som det kan læses ovenfor, står disse risici ofte ikke alene. En driftsfejl i brugen eller designet af en model kan for eksempel få meget stor indflydelse på en virksomheds omdømme. På den anden side kan forkerte beslutninger, der træffes med modeller, gøre at tilliden til funktionen lider skade, og derfor også have økonomiske konsekvenser. Desuden kan manglende gennemsigtighed og mulig bias i en model få indflydelse på en virksomheds omdømme, men kan også være i strid med love og regler. Et værktøjssæt som Lucid ser ind i denne legendariske "sorte boks" af modeller. Dette giver mulighed for objektivt at måle modellens gennemsigtighed, retfærdighed og nøjagtighed.

Trustworthy AI framework

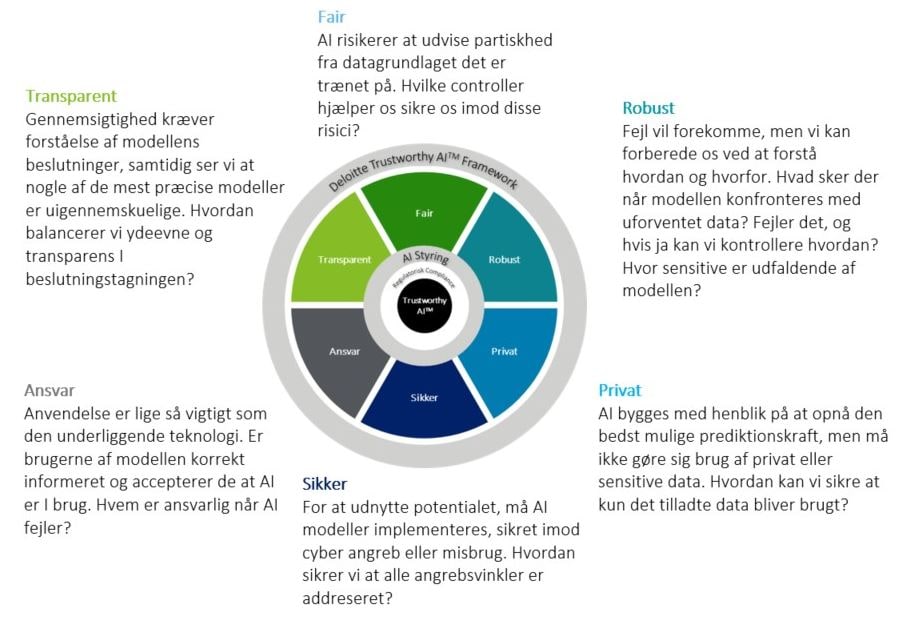

Deloittes Trustworthy AI framework består af 6 nøglekriterier som AI må leve op til for at blive betragtet troværdigt. Virksomheder der leverer funktionalitet og kvalitet uden at gå på kompromis med pålidelighed tilegner sig velfortjent tillid. Ved at levere funktionalitet og kvalitet uden at gå på kompromis med pålidelighed tilegnes velfortjent tillid.

Alle disse risici kan forekomme ikke kun under brugen af modellen, men på alle trin i livscyklussen for en model. Det er vigtigt, at alle interessenter medtages i hvert eneste trin i livscyklussen.

Jo senere fejl opdages jo større bliver omkostningerne, derfor er det vigtigt at prioritere troværdighed allerede fra konceptualisering. Dette begynder ved at udvikle en omfattende AI strategi, og klargøre konteksten AI vil blive brugt, den potentielle påvirkning kan have på virksomheden og involverede.

I udviklingsfasen må disse overvejelser og mulige påvirkninger tages i betragtning og AI kan bygges med henblik på at minimere risici, ved at benytte sig af de rette teknikker. Kvalitetssikring af AI er et stort og voksende område indenfor forskning, ved brug af et voksende katalog af teknikker og teknologier kan vi adressere problemer som transparens uden at gå på kompromis med ydeevne.

For at opnå dets fulde potentiale må AI integreres i system og proces landskabet, troværdigheden af AI skal ikke eksistere som en byrde for udviklere, men derimod være et middel til at få modeller i produktion til at bringe værdi uden at påtage sig unødvendig risiko.

Efter implementering kræver AI monitorering, virkeligheden benyttet til træning af modellen er sjældent et komplet billede af det data modellen møder i realiteten, derfor er det vigtigt at holde nøje med datadrift eller nye tilfælde der ikke er velrepræsenterede i træningsdataen.

Dette er blot eksempler på hvordan forskellige stadier i livscyklussen kræver forskellige overvejelser, AI modeller varierer markant i kompleksitet og anvendelse, et framework som Trustworthy AI forholder sig model-agnostisk da forskellige modeller medfører individuelle risici.

Implementeringen af rammeværket understøtter ansvarlig og etisk brug af modeller, samtidig med at de juridiske krav i en institution overholdes. Dette er i overensstemmelse med forslag til forordninger fra Den Europæiske Union. Et klart rammeværk gør det muligt at udnytte fordelene ved AI modeller til at udføre dens opgaver, samtidig med at risici styres.