洞察解析

從《柯南-黑鐵的魚影》看歐盟人工智慧法案及AI管理制度 ISO 42001

2024年趨勢解析《審計與確信篇》

勤業眾信確信服務 / 陳盈州會計師、周哲賢協理

一、AI的蓬勃發展與信任危機:

2023年7月在台灣上映電影「名偵探柯南:黑鐵的魚影」劇情提到在國際刑警組織的新科技設施「太平洋浮標」,結合了世界各個角落的警備監視系統,透過AI辨識人臉技術可以輕鬆比對資料從遠距離就可以找到罪犯。AI(Artificial Intelligence)人工智慧的發展可以追朔到1956年8月在達特茅斯的會議(Dartmouth Summer Research Project on Artificial Intelligence),該次的會議中定義許多重要的問題,如自然語言處理、神經網路與計算理論等驅動近代電腦科學發展的議題。1960年代人工智慧領域出現了一些重要的技術和方法,如基於規則的專家系統、機器學習和圖像識別等,之後的發展雖有曲折,但還是有下列驚奇:

- 1966年由Joseph Weizenbaum開發的ELIZA,一個可以透過英文與人進行交談的程式。

- 1997年由IBM開發的Deep Blue深藍成功挑戰西洋棋世界冠軍。

- 2011年IBM的Watson問答機器人成功在美國的智力問答節目贏過當時的冠軍。

- 2014年聊天機器人Eugene Goostman通過圖靈測試。

- 2015年微軟的深度學習技術,以96%影像辨識準確率首次超越人類的水準。

- 2016年Google的AlphaGo贏過世界圍棋冠軍柯潔。

- 2022年底OpenAI的生成式AI機器人ChatGPT橫空出世。

每次的突破都是讓人們拍案叫絕,如今AI的浪潮已經全面席捲各行各業,金融業運用AI協助KYC開戶、AML反洗錢、投資顧問或風險評估,醫療業運用AI進行基因序列資料分析、數位病理和智能藥物研發,建築業運用AI進行底稿設計、圖片渲染,教育界也運用AI進行課堂設計、語言教育、學習評量等,就連坐在辦公室的上班族也可以運用AI快速進行文案生成、資料挖掘與分析、語音轉譯等。人工智慧的好處大致可以歸類(1)提高生產力與效率;(2)改進客戶體驗;(3)加速資料分析能力;(4)降低風險與成本;(5)協助人類提高創新能力。

然而AI快速的發展也帶來新的信任危機,例如:AI招聘系統以公司過去的應徵者男性居多,而得到了男性應徵者比較適合的結論;AI影像辨識系統將非裔網友標示為「大猩猩」;律師在準備法庭文件時,利用AI來進行撰寫,結果引用的6個判例都是假的;透過AI協助設計晶片,過程中卻意外洩漏營業秘密;AI生成的黑白照片卻獲得Sony世界攝影大賽首獎;AI計算時所需的大量算力,依據荷蘭學者Alex de Vries預估,單就Google實施AI搜尋之後,其AI耗電量最高可能達到27.4 TWh,接近愛爾蘭一整年所使用的電力(29.3 TWh)。

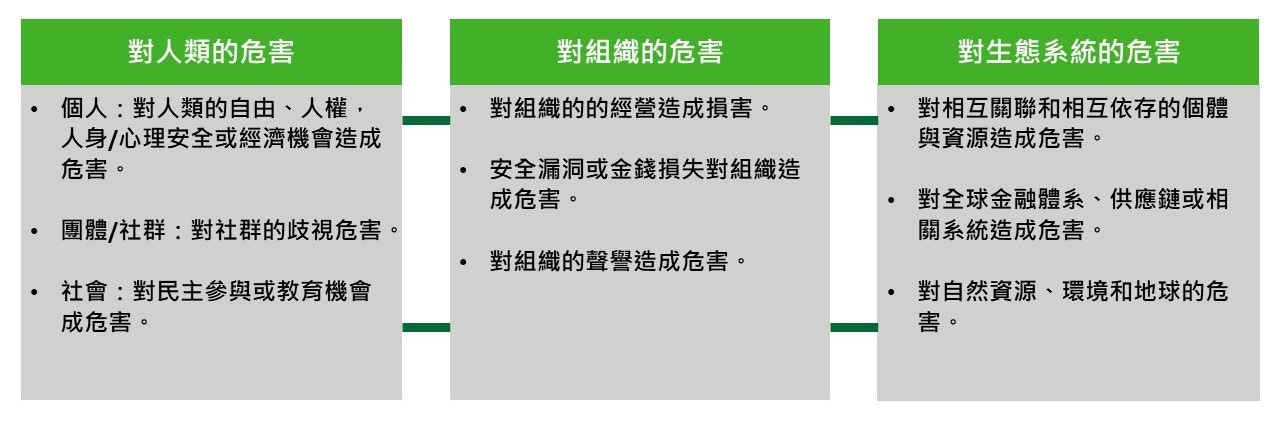

圖一:美國NIST提出AI的三大潛在危害

(資料來源:NIST)

二、 歐盟人工智慧法案(EU AI Act)

有鑑於AI的高速發展各國政府也開始制定法令法規,其中最引人注目就是歐盟委員會正提出有史以來第一個人工智慧法案,該法案旨在解決人工智慧的風險,並使歐洲在全球發揮領導作用,該法案草案已於2023年5月通過,於2023年12月9日達成政治協議,並預計2024年正式通過並於2026年開始生效,若違反的企業則將面臨最高3,500萬歐元,或營業額7%的罰款,目前歐盟人工智慧法案定義了AI的4個風險等級:

- 不可接受的風險—禁止使用AI:所有被認為對人們的安全、生計、認知行為和權利構成明顯威脅的人工智慧系統都將被禁止,如:政府從不相關事務(父母親曾對已約好的醫生看診卻失約、離婚)對當事人進行的社會評分、使用語音輔助鼓勵從事危險行為的玩具等。

- 高風險—受監管使用AI:可能使公民的生命和健康面臨風險的關鍵基礎設施(例如交通)、可能決定某人接受教育和職業生涯的機會(例如考試評分)、信用評分可能剝奪了公民獲得貸款的機會、人工智慧在機器人輔助手術中的應用、。

- 有限風險—透明化義務:有限風險是指具有特定透明度義務的人工智慧系統。當使用聊天機器人等人工智慧系統時,用戶應該意識到他們正在與機器互動,以便用戶可以做出繼續或不使用的決定。

- 低風險/極小風險:該提案允許免費使用風險最小的人工智慧。這包括人工智慧視訊遊戲或垃圾郵件過濾器等應用程式。

而上述提到的「高風險AI系統」在推出市場之前將受到嚴格的義務約束,而它要求重點如下:

- 適當的風險評估和導入管理制度/系統。(註:可參照NIST AI Risk Management Framework、導入AI管理制度ISO 42001)

- 為AI系統提供高品質的資料來源,以盡量減少風險和歧視性結果。

- 記錄活動以確保結果的可追溯性。(註:日誌)

- 提供有關AI系統及其用途的所有必要資訊的詳細文件及其透明性,以便當局評估其合規性。(註:演算法、技術文件、訓練資料來源等)

- 向使用者提供清晰且充分的資訊。(註:使用手冊)

- 採取適當的人力監督措施以盡量減少風險。

- 高水準的穩健性(Robustness)、資安和準確性。

而所有遠端生物識別系統都被認為是高風險並受到嚴格的要求。原則上禁止在公共場所出於執法目的使用遠端生物特徵識別。但是若是例外情況則受到嚴格定義和監管,例如:在必要時尋找失踪兒童,防止特定且急迫的恐怖威脅,用以偵查、定位、識別或起訴嚴重刑事犯罪的肇事者或嫌疑人。因此,「名偵探柯南:黑鐵的魚影」劇情AI太平洋浮標設施若長時間的監視可能是「不可接受的風險」而禁止使用,但若為急迫的特定恐怖威脅,則可以在高度監管下限制使用。而此類使用須經司法或其他獨立機構授權,並受到時間、地理範圍和搜尋資料庫的適當限制。

此外,歐盟的AI法案還將針對AI系統發布CE標章,定義與要求AI系統應加貼CE標章並簽署合規聲明,要求在AI系統的生命週期須合規等遵循性要求,包含AI設計時要符合預期目的、AI使用前要取得合格評測、AI上線部署後持續合規監控、嚴重事故或侵犯基本權利時應通報、系統重大變更時應重新評估等。

三、 AI管理系統ISO 42001

國際標準組織正在發展ISO/IEC 42001,目前已於2023年12月完成FDIS投票,並於2023年12月18日推出正式版,這個AI國際標準有幾項特點:

- 全世界第一部可以驗證的人工智慧的管理制度標準(AIMS)。

- 提供組織在範圍內建立、實施、檢討和行動(Plan-Do-Check-Act)的人工智慧管理系統。

- 定義AI開發者、維運商、使用者等不同角色與責任。

- 適用於任何提供或使用AI人工智慧系統的產品或服務的組織。

- 可以跟ISO其他管理制度高度整合,並須合規各國法令法規。

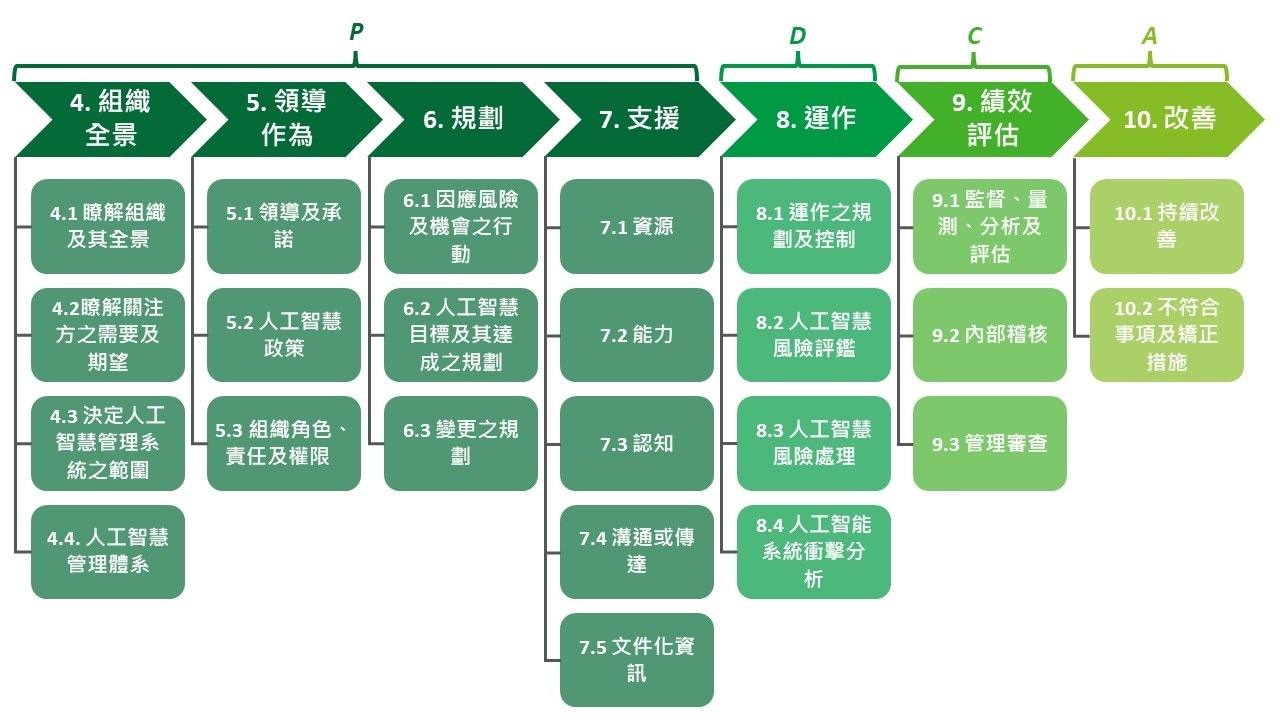

圖二:ISO 42001 DIS本文採用Annex SL架構,高度整合其他國際標準

ISO 42001本文也採用Annex SL架構,(同ISO 27001、ISO 9001、ISO 223012等)附錄A有9個控制領域包含共39個控制措施,附錄B則為控制措施的參考指引、附錄C則提到AI相關組織目標(Objectives)及風險來源(Risk source)、附錄D為跨行業或領域(如:健康、防禦、運輸、金融、就業、能源)與不同ISO標準(如:ISO 27001、ISO 27701、ISO 9001)運用AI的使用指引、AI產品/流程/服務的驗證注意事項。

圖三:ISO 42001 DIS 附錄A:人工智慧系統控制目標與控制措施

9個控制領域:人工智慧政策、內部組織管理、人工智慧系統資源、人工智慧系統影響評估、人工智慧系統生命週期、人工智慧系統數據、關注方須了解的資訊、人工智慧系統的使用、第三方關係。礙於章節限制,以B.6.2人工智慧系統生命週期為例,組織需要考慮採取以下控制措施:

- 負責任地設計與開發可信任的(Trustworthy) AI系統

- 定義AI的設計與開發過程

- 明確AI系統的需求與規格

- 確保AI的設計與開發過程文件化

- 對AI進⾏驗證和確認(Verification and Validation)

- 對AI系統的部署進⾏管控

- 對AI系統的運作和監控進⾏控制

- 確定所需的AI系統技術文件

- 對AI系統的事件⽇誌進⾏記錄

四、NIST AI風險管理架構

2023年1月美國國家標準局 NIST發布AI風險管理架構 v1.0(Artificial Intelligence Risk Management Framework),提出人工智慧管理需要有以下四大要素:

- 治理(Govern):整合AI的風險管理過程,將規劃、評估、管理三個面向進行統一管理,制定讓團隊與個人均能有效完成任務的管理政策,用以解決第三方及其他供應鏈問題所引起的AI風險。

- 規劃(Map):識別AI系統的背景以及與有關的風險,將組織的政策、目標、法令法規與AI系統的功能和風險聯繫起來,並進行分析以確認對於AI系統的功能、安全要求、控制措施、操作及維護方面的要求。

- 評估(Measure):評估、分析或追踪已識別的風險,對於已識別出的風險進行追蹤,確認AI系統風險狀態。

- 管理(Manage):根據規劃與評估對AI的風險進行優先排序、回應與管理,並根據AI使用者的回饋,規劃、實施並記錄,告知其最大效益與降低風險處置方法。最後,對已經識別出的風險進行處理,並定期記錄和監控。

圖四: 美國NIST提出七大AI模型可信任特徵,可作為AI風險評估項目

(資料來源:NIST)

上述對AI系統進行風險評估(Measure)的步驟就是對「可信任的AI系統」進行七大特徵評估:(1)有效且可靠的(Valid &Reliable)、(2)安全(Safe)、(3)有保障且有韌性(Secure & Resilient)、(4) 可歸責與透明性(Valid &Reliable)、(5)可解釋與可解讀(Explainable & Interpretable)、(6)強化隱私(Privacy-Enhanced)、(7)公平並管理有害偏見(Fair – With Harmful Bias Managed)。2023年12月台灣數位發展部成立「AI產品與系統評測中⼼」亦對上述項目進行類似的評測,提供國內AI產品評測服務,以保障使⽤者權益。

五、結語:一切都在變好 AI新時代的奇異點將引來曙光

AI的爆炸性的成長將為人類生活迎來新的跳躍式發展,2023年11月電動車的領導品牌也在北美發表最新的自動輔助駕駛V12版本,標榜可以真正自動化駕駛的版本正式發布;截至2023年12月,已有超過4,800顆低軌道通訊衛星在太空軌道運作服務,實現全球無死角的網際網路連線已不是問題。2023年12月初人類推出全世界第一台「模組化」的量子電腦,並內建首次超過1,100個量子比特(Qubit)的量子處理器,在配合開源的量子程式設計軟體Qiskit v1.0發布,未來可透過量子演算運用AI超高速運算與新技術的發展擘劃出無限的可能。

企業在建置、使用、管理AI技術時參考歐盟AI法案、美國NIST AI Risk Management Framework、國際標準組織ISO 42001都是很合適的選擇,勤業眾信在過去有豐富的輔導及諮詢經驗,相信可以與所有企業共同努力,藉由新興科技之運用,邁向更美好的未來。