【コラム】AIガバナンスと知財 ブックマークが追加されました

ナレッジ

【コラム】AIガバナンスと知財

データプライバシー法制強化で備えるべきAIガバナンス体制と知財部の役割

データプライバシーを中心にAI倫理の問題が提示され、人間の尊厳・権利保護のため数多くのガイダンス等が発行されている。2021年には欧州でAI規制案が提示される中、AIガバナンス体制の構築が急務であり、知財部が果たし得る役割を提示する。

知財部におけるAI利活用トピック例

あらゆる産業で、AIの影響力が加速度的に高まっている。

膨大なデータ量を処理・分析してサービスを展開するにあたり、AIの存在は今や不可欠である。AIにより、人々はきめ細やかなサービスの享受を実感でき、そのメリットは今後も増加し続ける点においては衆目の一致するところと考えている。

AI利活用は知財活動の現場においても活発化し、下記トピックが存在していると思われる。

《知財活動におけるAIトピック例》

■AIを用いた発明・考案・創作の促進

- COVID-19の発生でも注目されたAI創薬*1 が代表事例で挙げられる。AI創薬は薬の研究開発過程におけるAIの活用を指し、医薬品の候補となる分子の探索や、薬剤の動態予測や、医用画像解析等を通じた薬効や安全性の評価の用途が期待されている。

- また、創作分野でのAI利用も話題となっている。Microsoftとオランダの金融機関 ING グループに加え、レンブラントハイス美術館、デルフト工科大学等が、AIを使ってバロック時代の有名画家レンブラントの「新作」を2016年に発表した*2 。AIは創造性に弱みがあり、人間の優位性があるとされていたが、AIの可能性を感じさせる事例である。

- 現在は、AIの創作に係る技術革新も進み、エンターテイメント業界等の創作現場での利用が進められている。例えば、ゲーム業界におけるAI利用として、ノン・プレイヤー・キャラクター(NPC)のキャラクター造形や、背景・美術、果ては台詞生成も進みつつあり、人手作業からの移行により業務効率の向上が図られている*3 。

■ 権利自体としてのデータセット・学習済みAI

- 不正競争防止法の平成30年改正では、一定の価値あるデータとして「限定提供データ」の概念が導入され、保護対象に加えられた。「限定提供データ」は、不正競争防止法2条7項で以下のように定義されている。

業として特定の者に提供する情報として電磁的方法により相当量蓄積され、及び管理されている技術上又は営業上の情報

- AI学習用のプログラムおよび学習済みモデルは、コンピュータプログラムとして、著作権法2条1項10の2号で保護されうる。また、プログラムは一定条件下で特許法上の保護対象ともなり得て、特許庁の「特許・実用新案審査ハンドブック」には、2つのニューラル・ネットワークから構成される学習済みモデルの発明例が提示されている*4 。

※1:「AI創薬が『当たり前』になる日が近づく、分業化する新たな製薬業界の姿」日経クロステック/日経デジタルヘルス(2021年7月1日公表 2022年7月28日閲覧)https://xtech.nikkei.com/atcl/nxt/column/18/01699/062800002/

※2:「人工知能が描いた『レンブラントの新作』」 Wired(2016年4月14日公表 2022年7月28日閲覧)https://wired.jp/2016/04/14/new-rembrandt-painting/

※3:「よりリアルに人間らしく。進化するNPC開発の最前線」モリカトロンAIラボ(2020年12月28日公表 2022年7月28日閲覧)https://morikatron.ai/2020/12/npc_ai/

※4:附属書B「特許・実用新案審査基準の特定技術分野への適用例」特許庁(2022年7月28日閲覧)https://www.jpo.go.jp/system/laws/rule/guideline/patent/handbook_shinsa/document/index/app_b.pdf

学習用データ調達から発生するAI倫理問題

上述の権利自体としてのデータセット・学習済みAIをどのように管理していくかが、知財部門の重要なテーマと考えている。特に近年は、データソリューションビジネスの拡大に代表されるように、モノからコト化の進展に伴い、データの収集や取扱いに注目が集まっている。データソリューションのコアバリューを支えるAIの精度向上には、データセットの質・量が重要となる。

データの代表的な収集方法例として、自社サービスを利用した収集や、データベンダーからの購入やオープンデータセットの利用、更にウェブスクレイピング*5 手法の導入やAI等を用いた合成データの生成等が挙げられる。例えば、自動運転の場合、各国別に交通法規が異なり、標識などの差異もあれば、道路事情も異なる。また、事故回避のため、交通シーンの情報も必要となる。そのため、幅広い国・地域における膨大な道路事情や交通標識等のデータが必須となり、車載カメラ等を用いて自動車メーカーやデータベンダー等によって収集される。

自動運転に留まらず、データセットの拡充には、自社リソースにのみ着目したデータ収集に留まらず、パートナー企業やデータベンダー、オープンデータセットといった外部リソースの利活用を検討することが望ましい。

一方で、目先のデータソリューション開発ばかりに注目し、データに含まれる被写体やデータ調達先の利用条件に注意を疎かにすると、GDPR*6 を始めとするプライバシー法制や、著作権等の違反・侵害リスクが高くなる。また、法規制以外にもデータの取扱いを誤ると、意図せざる社会的な批判を受ける等で各社のブランドやレピュテーションの毀損も生じうる。

《社会的な批判例》

現在、顔認識や位置情報技術を利用した法執行機関による大衆監視は、米国や欧州を中心に、批判の対象となっている。2020年に米国内で発生したBlack Lives Matter運動では、大衆監視技術も批判の矛先となり、当該技術を提供する大手プラットフォーマー企業群が、次々と顔認識技術の開発中止や、法執行機関への提供中止を公表した*7 。

また、直近ではウェブスクレイピング技術を用いて個人画像を収集・データベース化し、法執行機関へサービス提供している企業が、英国やイタリアを始めとする各国・地域のデータ保護機関からプライバシー法制に基づく制裁金やデータ破棄命令を受けている*8 。

上記の通り、データ収集には法規制と社会的な批判に係るリスクがあることを理解されたい。プライバシーやAI関連のデータ取り扱いの指針は、経済産業省や総務省を中心にガイドライン*が提供されており、随時最新版を参照すべきである*9 。

提供されているガイドラインは、諸外国との国際協調を踏まえた記述内容となっていると推察されるが、グローバル展開を前提とするサービス開発において、サービス展開国の最新の法規制ならびにガイドラインの把握が必須となる。参照先の法規制・ガイドラインは多岐にわたるため、各国の法律事務所や自社拠点等への確認が、実務上望ましい態様と考えられる。

※5:ウェブサイトから情報を取得し、その情報を加工して新たな情報を生成する手法

※6:一般データ保護規則(2022年7月28日閲覧)https://eur-lex.europa.eu/eli/reg/2016/679/oj

※7:「『顔認識技術を禁止せよ』 黒人差別を受けハイテク大手の対応は?」ITmediaビジネスONLINE(2020年6月17日公表 2022年7月28日閲覧)https://www.itmedia.co.jp/business/articles/2006/17/news017.html

※8:「顔認識データベース『Clearview AI』は何がタブーだったのか」プライバシーテック研究所(2022年6月1日公表 2022年7月28日閲覧)https://acompany.tech/privacytechlab/clearviewai-face-data-privacytech/

※9:総務省AIネットワーク社会推進会議(2022年7月28日閲覧)https://www.soumu.go.jp/iicp/research/results/ai-network.html

経済産業省AIガバナンス(2022年7月28日閲覧)https://www.meti.go.jp/policy/it_policy/ai-governance/index.html

AI技術とAI倫理

前章では、データセットの問題を紹介したが、AI技術そのものに対しても批判を受ける可能性がある。2021年1月には、死者とも仮想上の会話ができるチャットボット技術に係る特許を大手ソフトウェア開発・販売企業が取得し、ネットで物議を醸した。ネットでの反応に対して、この企業のAIプログラム担当者は同月に、「(製品化の)計画はないことを確認する」とツイートし、あわせて出願した2017年4月時点では、現在のようにAI倫理を巡る厳しい目が向けられていなかった」と言及していた。

上記の事例は、故人の尊厳を冒すものとして批判を浴び、製品化計画を手控える発表に追い込まれたものであった。

故人の尊厳に係る類似の国内事例として、AIで「復活」した昭和の名歌手が、2019年の大晦日のテレビ番組に出演した事例が挙げられる。記憶に残る事例であるが、本件も相当の反発を含む反響が見られた。名歌手との「再会」を喜ぶ人もいれば、疑問を覚える人も生んだ*10 。

上記事例は、AI倫理問題として扱われているが、特に利用許諾の判断が出来ない故人を生成することの重みを考える必要があった。

こうしたAIのもたらす価値のトレードオフに対して、EUを始め、世界的に法規制(ハードロー)が整備され始めている。2021年4月に、欧州委員会は「欧州AI規制案」を提示した*11 。同規制案は、AIのリスクを「許容できないリスク」・「ハイリスク」・「限定的なリスク」・「最小限のリスク」の4段階に分類している。

最も厳しい「許容できないリスク」例は、サブリミナル技術の利用、政府が個人の信用力を格付けする社会信用システムの運用、顔認証などの遠隔生体認証技術の公共の場でのリアルタイム利用が挙げられる。「ハイリスク」例は、雇用・教育・医療・法執行などの分野で個人の重大な利益に係る意思決定、重要なインフラでの利用が挙げられる。また、生体認証等で用いられる安全性や、基本的人権に悪影響を及ぼすものについても同様となる。

「ハイリスク」に該当するAIシステムの提供事業者には、提供開始前に規定要件の適合性評価手続きをとることが義務化され、提供後もリスクや品質の徹底管理が求められる。

「限定的なリスク」は、AIシステムを利用していることを開示する義務が課される。メディアにおいてはチャットボットも対象範囲である。

「最小限のリスク」は、上記3区分に含まれないAIシステムであり、各社による行動規範の自主的な策定が促される。

本規制案が、法として発効するまでには数年を要すると見られる。しかし、GDPR同様、域外規制が求められ、いわゆるブリュッセル・エフェクト*12 と呼ばれる現象が世界的に影響力を及ぼす可能性が高く、日本企業も準備が必要となる。

また、2021年11月には国連教育科学文化機関(UNESCO)がAI倫理規範を採択、加盟国への勧告がなされた*13 。同規範は、「いかなる人も、AIによって経済、政治、精神的に傷つけられてはならない」ことが明記されている。また、AI活用において、人権や基本的自由、プライバシーを尊重するよう、各国政府に対応を求めている。特に文化や言語、性別の違いで差別を生まないような配慮も必要としている。同規範に法的拘束力はないが、先述の欧州AI規制案と相まって、世界的なAI規制の原動力になると考えられる。

※10:【開催報告】2020年度人工知能学会全国大会(2020/6/10)「人を”よみがえらせる”技術としてのAI創作物:AI美空ひばりとAI手塚治虫を例に」人工知能学会倫理委員会(2020年6月22日公表 2022年7月28日閲覧)http://ai-elsi.org/archives/1088

※11:2020年2月公表の、AIのリスク対応とAI開発の推進の両面でEUが世界的な主導権を握るべきとする「AI白書」を具現化したもので、EUと加盟国間の協調計画等と併せて2021年4月21日に公表https://ec.europa.eu/commission/presscorner/detail/en/ip_21_1682

[規制案] (2022年7月28日閲覧)https://eur-lex.europa.eu/legal-content/EN/TXT/?qid=1623335154975&uri=CELEX%3A52021PC0206

※12:コロンビア大学アヌ・ブラッドフォード氏の提唱概念EUが豊富な人口を強みに、強固なルールを先んじて打ち出すことで、企業が仕様を適合させる。コスト観点から、同仕様をグローバル市場でも使用することで、結果的にEUのルールがスタンダードとして普及することを指す

※13:AIの健全な発展を確保するために必要な法的基盤の構築の指針となる共通の価値観と原則を定義した勧告。2018年に策定が開始され、2021年11月25日に、UNESCO加盟の193カ国が本倫理的枠組みに係る勧告を正式に採択。本勧告は、AIが社会にもたらす利点を実現し、リスクを低減することを目的とし、データガバナンス、教育、文化、労働、医療、経済に関する行動指針を含む各国への政策提言を含むhttps://en.unesco.org/news/unesco-member-states-adopt-first-ever-global-agreement-ethics-artificial-intelligence

[勧告全文] (2022年7月28日閲覧)https://unesdoc.unesco.org/ark:/48223/pf0000380455

AI倫理を巡る、知財部門が果たし得る今後の役割

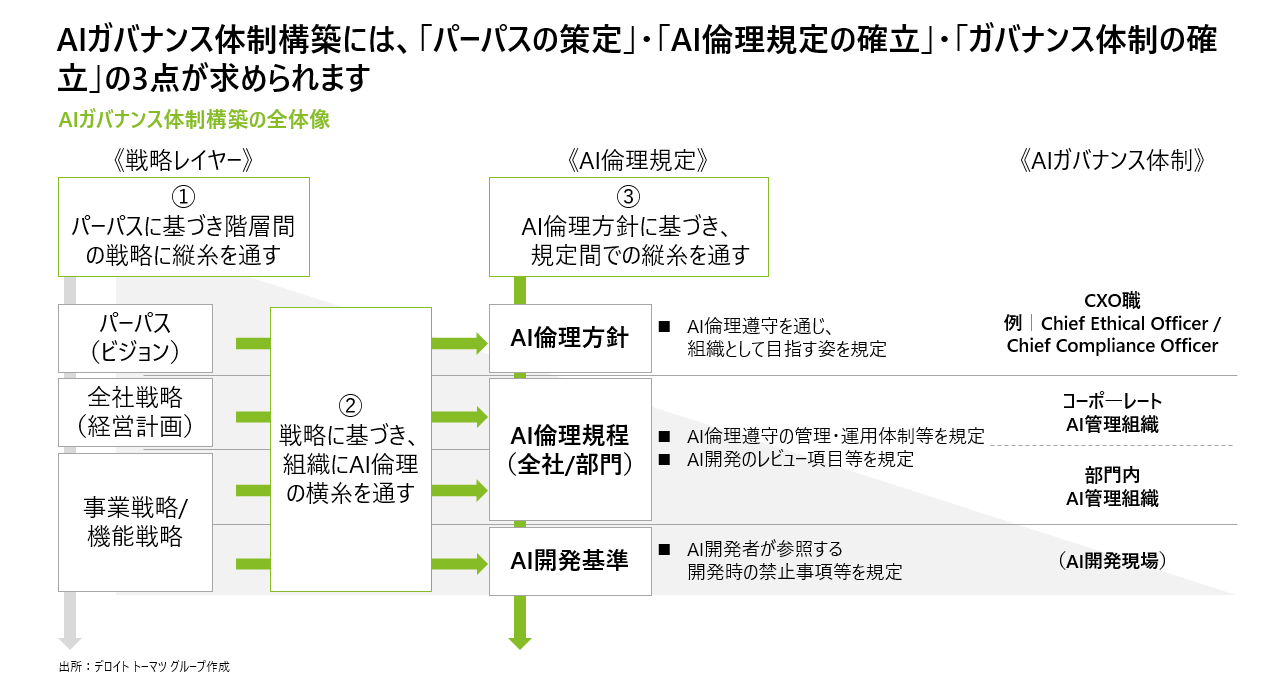

上述の通り、AIに係るデータセットやAI技術(モデル含む)は、AI倫理の観点での注目がなされ、法規制化が進展している。AI倫理の対応として、AIガバナンス体制が必要で、経営課題として捉えるべきと考えている。AIガバナンス体制構築の一例として、図1に示すような体制構築が考えられる。

先進的な取り組みを実施している企業では、AIガバナンスの構成主体として、次のような属性・部門人材が中心となっている。

【AIガバナンスの構成主体像】

■CXO職・事業部門責任者

- 全社戦略あるいは事業戦略に基づくビジネス文脈において、AIの取り扱いに係る最終的なGo/No Go判断を行う

■研究・開発部門(AI・データサイエンティスト)

- AIの企画・設計・開発従事者あるいは経験者

- AI関連問題に直面あるいは背景知識を有していることが多い

■法務部門・法律事務所

- AIの取り扱いにつき、法規制・ガイドラインに基づく法的観点での判断が可能

■コンプライアンス部門・CSR部門

- 企業内のレピュテーションに係る活動経験があり、エンドユーザーとの窓口や社内・社外連携の知見が豊富

一見すると、知財部門が介在する余地は僅少であるように見受けられる。しかしながら、筆者としては知財部門の参画余地は十分にあり、有用な組織貢献が可能と推察する。

(知財部門機能別の取組み参画への効果仮説)

■事業戦略と連携した全社横串の知財・データ戦略の立案(支援)機能

- AI倫理の規定は、企業のパーパス・全社戦略に紐づく、事業戦略に対応した規定策定が望ましい

事業内容により、AI倫理上の要配慮事項が異なる

(ex.画像認識事業においても、大衆監視技術と物流現場での物品認識技術では、遵守すべき法規制・ガイドラインの規定や社外の関心度合いが異なるため)

- 技術やデータ基点で事業全体を俯瞰できる知財部門であれば、AI倫理規定の策定過程においても、同規定が必要となる事業整理に大きな役割を果たし得る

■データセット・プログラム(AIモデル)の一元管理機能

- 知的財産としてのデータセット・プログラムは、法域別に特許や著作物、営業秘密に分類され、知財部門にて管理されるケースが想定される

- データセット・プログラムが知財部門の管理対象となっていれば、バリューチェーン全体でのデータ流通情報を追跡・管理しやすいと思料

AI倫理に関する法規制・ガイドラインでは、データ流通の透明性の確保

(ex.誰から、どういった条件で、被写体への同意を得て、購入したか)や外部への説明責任が求められている

- データセット・プログラム(AIモデル)の一元管理により、AI倫理関連の問題(候補)事象の特定支援や、AI倫理上の問題発生に繋がるデータ調達等の検知がしやすく、法務や購買部門と連携し、取引への助言が可能と推察

現時点で、日本企業のAI倫理に関する認知・関心は低い印象を受けるが、AI関連規制の波は国外より着実に押し寄せる。この新たな「黒船」への早期の備えは必須となる。

多くの日本企業がモノからコトへのモデル転換期にあり、データの重要性が高まり、データ管理を含めた知財部門の再編も検討され始めている。

本記事が、データ管理対応が必要とされる組織再編の検討、および各社のAIガバナンス体制構築において、全社貢献が果たせる組織化検討の一助となれば幸いである。

執筆者

デロイト トーマツ ファイナンシャルアドバイザリー合同会社

知的財産アドバイザリー

シニアアナリスト 濱田 智久

監修

デロイト トーマツ ファイナンシャルアドバイザリー合同会社

知的財産アドバイザリー

パートナー 國光 健一

(2022.8.15)

※上記の社名・役職・内容等は、掲載日時点のものとなります。